2026西湖龙井茶官网DTC发售:茶农直供,政府溯源防伪到农户家

2026西湖龙井茶官网DTC发售:茶农直供,政府溯源防伪到农户家

将点积注意力替换为径向基函数注意力听起来像是一场架构革命。但在拉斐尔·皮索尼的实验中,结果却更加奇特:这实际上只是一个单行代数微调,却在悄然复现现代变换器一半的“神秘”行为——同时还在过程中打破了硬件栈。

简而言之

- 径向基函数注意力本质上就是点积注意力加上对键向量显式的平方 L2 惩罚;这种“新”的几何结构其实早已隐含在缩放点积注意力(SDPA)之中。

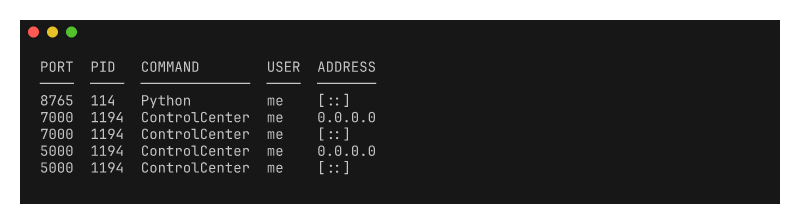

- 一旦改变度量方式,你就不得不直面整个技术栈中所有围绕点积硬编码的假设:包括旋转位置编码(RoPE)、注意力汇聚点、融合内核,甚至你调试训练的方式。

- 使用径向基函数注意力的正确方式是将其作为一种诊断手术刀:借鉴其归纳偏置(如范数惩罚、基于距离的相似性),而不必承担彻底替换所带来的全部工程代价。

径向基函数注意力其实就是点积注意力加上对键向量的 L2 惩罚

皮索尼的数学技巧是关键:从基于距离的得分出发,而非点积:

[

\text{score}(q,k) = -\gamma\lVert q - k\rVert^2

]

并展开:

[

-\lVert q - k\rVert^2 = -\lVert q\rVert^2 + 2 q\cdot k - \lVert k\rVert^2

]

对键向量进行 Softmax 运算是平移不变的,因此对于固定的查询向量,(-\lVert q\rVert^2) 项只是一个常数偏移,会被消去。剩下的就是:

[

\text{softmax}(-\gamma\lVert q - k\rVert^2) \equiv \text{softmax}(2\gamma\,q\cdot k - \gamma\lVert k\rVert^2)

]

因此,缩放后的径向基函数注意力在代数上等价于:

- 常规的点积注意力项(q\cdot k),再加上

- 一个内置的 L2 惩罚项,会抑制大范数键向量的得分。

第一个不那么明显的推论是:你并不需要一种全新的注意力原语来获得“径向基函数效应”。你可以继续使用缩放点积注意力(SDPA),只需为每个键向量显式添加一个 (-\lambda\lVert k\rVert^2) 的得分偏置即可。PyTorch 的FlexAttention 正是为了让你能够注入这类得分修改,同时仍能编译成类似 FlashAttention 的高效实现。

这意味着,“基于距离的注意力”与其说是一类独立的方法,不如说是对点积注意力已有几何结构的一种重新参数化。

真正的问题变成了:这个对键向量范数的惩罚究竟会对模型的行为产生什么影响?

为何对键向量范数施加惩罚会改变注意力的几何结构

在标准的点积注意力中,得分为:

[

\text{score}(q,k) = \frac{q\cdot k}{\sqrt{d_k}}

]

从几何角度看,这相当于“余弦相似度乘以向量模长”。即使某个键向量与查询向量方向并不一致,只要其范数足够大,依然可以“胜出”——皮索尼称之为“模长霸凌”。

我们早已知道网络会依赖这一点。注意力汇聚点现象(例如 StreamingLLM 中的汇聚点以及标点符号汇聚点)表明,模型会刻意让少数标记拥有极大的范数,以便在没有其他相关内容时吸收概率质量。这种技巧之所以存在,正是因为当前的评分规则奖励大范数。

而径向基函数注意力则悄然废除了这一技巧:

- 得分被上限约束(最大值出现在距离为零时),因此你无法通过无限增大范数来获得无界的 logits。

- 大范数键向量会在所有查询中受到惩罚,而不仅限于某一个查询。异常值键向量需支付全局性的“税”。

这对注意力的“形状”产生了两方面影响:

局部性变得字面化。 “相似”现在真正意味着“在欧几里得空间中距离接近”,而不再是“在某个轴上的投影很大”。你正在引导模型倾向于聚类且具有度量意义的表示。

免责声明:本文内容来自互联网,该文观点不代表本站观点。本站仅提供信息存储空间服务,不拥有所有权,不承担相关法律责任。如发现本站有涉嫌抄袭侵权/违法违规的内容,请到页面底部单击反馈,一经查实,本站将立刻删除。