2026西湖龙井茶官网DTC发售:茶农直供,政府溯源防伪到农户家

2026西湖龙井茶官网DTC发售:茶农直供,政府溯源防伪到农户家

凌晨两点。客户 Slack 频道炸开了锅——支持机器人连续三次询问同一个订单号。一位沮丧的用户大喊:“你们是有失忆症吗?”在仔细检查代码和提示词后,一切看起来都正常。直到这时我们才发现,ConversationBufferMemory(对话缓冲记忆)在其中一轮对话中静默地丢弃了上下文。大语言模型完全不知道之前说过什么。就在那一刻我想到:如果我们能在持续集成中自动捕获这种记忆丢失问题,我们就永远不会发布这样令人难堪的缺陷。

剖析问题

在大语言模型驱动的应用中,记忆功能不再是“锦上添花”,而是核心体验。LangChain 为我们提供了丰富的记忆实现方案:ConversationBufferMemory(对话缓冲记忆)、ConversationSummaryMemory(对话摘要记忆)、VectorStoreRetrieveMemory(向量存储检索记忆)等。但几乎没有项目真正严肃地测试记忆准确性。

根本原因极其简单:记忆测试过于依赖人工。大多数团队在本地启动一个链,用 Postman 或命令行界面进行几轮交互,肉眼确认“是的,它记住了我刚才说的名字”,然后合并代码。这种方法有三个致命缺陷:

- 路径覆盖率极低——人工测试只覆盖理想路径。分支条件(触及令牌限制、摘要记忆触发时机、消息交错等)全靠猜测。

- 零回归保护——下周你调整提示词或切换模型时,记忆逻辑可能会崩溃,但没有人会手动重放每一段历史对话。

- 验证模糊——“看起来正确”不等于确实正确。人类对记忆是否完整或是否存在幻觉的判断存在巨大的误差范围。

用这种手工方式来测试有状态、长上下文的代理,就像蒙着眼睛穿越高速公路。我们需要一种基于自动化断言的记忆验证方案:给定多轮对话脚本,精确验证记忆对象中存储的内容、顺序和关键事实——并在持续集成中运行它。

方案设计

核心思路很简单:将大语言模型变成确定性的“提词器”,然后将记忆对象作为被测系统,并使用 pytest 进行断言。

为什么不让大语言模型自己判断记忆?(例如,再次调用模型:“请检查对话历史是否包含 X”)。因为那样会让“裁判”成为同一台产生幻觉的机器——不可靠。我们需要的是纯粹的工程断言:字符串包含、列表长度、消息类型——确定性检查。

工具选择:

- pytest:最通用的 Python 测试框架;其夹具机制非常适合管理记忆状态。

-

LangChain 的

BaseMemory:我们直接与memory.chat_memory.messages和memory.load_memory_variables()交互,绕过大语言模型的不确定性。 -

自定义

FakeLLM:继承自LLM,按预定序列返回固定文本,零外部 API 依赖。测试在毫秒级完成,且 100% 可重复。

我们避免模拟 ChatOpenAI,因为网络抖动和模型随机性会直接破坏断言的稳定性。我们也不将 FakeListLLM 视为黑盒——我们需要精确控制每一次回复,因此自定义的 HardcodedLLM 给了我们最大的灵活性。

核心实现

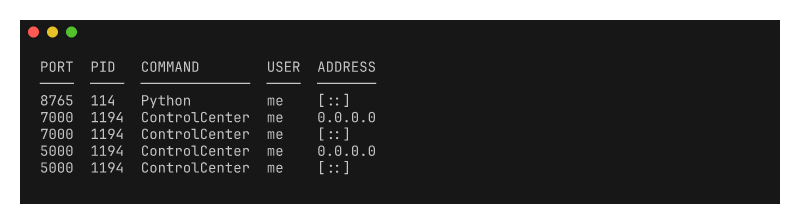

让我们逐步构建自动化记忆测试。所有代码均可运行(需要执行 pip install langchain langchain-core pytest)。

免责声明:本文内容来自互联网,该文观点不代表本站观点。本站仅提供信息存储空间服务,不拥有所有权,不承担相关法律责任。如发现本站有涉嫌抄袭侵权/违法违规的内容,请到页面底部单击反馈,一经查实,本站将立刻删除。