2026西湖龙井茶官网DTC发售:茶农直供,政府溯源防伪到农户家

2026西湖龙井茶官网DTC发售:茶农直供,政府溯源防伪到农户家

人工智能视频增强是那些常被用戏剧性的前后对比片段进行营销,却很少解释其底层实际运作原理的功能之一。

本文探讨了其技术基础——模型正在执行什么操作、它们在哪些方面表现良好,以及在哪些方面会遇到真正的局限。

传统方法的问题

经典视频处理工具(例如 FFmpeg 滤镜、VirtualDub、早期锐化算法)在像素空间中通过手工制定的规则进行处理:

- 锐化:使用拉普拉斯算子或非锐化掩模等卷积核,增加检测到的边缘处的对比度

- 降噪:对周围像素值取平均(高斯模糊、中值滤波)

- 放大:双三次或双线性插值——本质上是对相邻像素进行加权平均

这些方法速度快且具有确定性,但它们存在一个根本性的上限:它们没有关于内容应该呈现何种样貌的模型。降噪滤波器无法分辨一片变化区域是胶片颗粒还是织物纹理。锐化卷积核不知道它面对的是人脸还是背景。它们在任何地方都应用相同的操作。

结果是可以预见的:过度锐化的光晕、模糊的纹理,以及那种独特的“经过处理”的外观。

深度学习如何改变这种方法

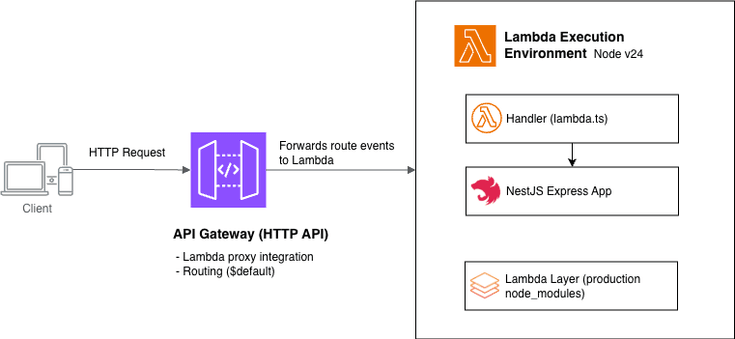

现代人工智能增强使用卷积神经网络,以及更近期的基于变换器架构的模型,这些模型在成对的低质量/高质量视频帧的大型数据集上进行训练。

该模型学习一种映射关系:给定一个降质的输入图块,预测干净的输出应该是什么样子。在训练期间,网络会看到数百万个噪声模式、压缩伪影、模糊和色彩降质的示例——并与它们的真实干净版本配对。

在推理阶段,模型不是在应用规则。它是基于上下文做出学习到的预测。这就是为什么它能够:

- 在去除噪声的同时保留纹理(它已经学会了噪声与纹理的区别)

- 重建边缘而不产生光晕(它了解边缘上下文,而不仅仅是梯度幅度)

- 恢复色彩而不过度饱和(它已经学会了自然的色彩分布)

实际优势在于:输出看起来像是更好的源素材,而不是经过滤镜处理的素材。

帧插值:一个独立的问题

放大和降噪是针对单个帧进行的操作。帧插值则是一个不同的挑战:在现有帧之间合成新帧以提高帧率。

朴素的方法(混合相邻帧)会在任何存在运动的地方产生重影伪影。人工智能方法使用光流估计——计算帧之间的运动矢量,然后沿预测的运动路径扭曲并混合源帧,以生成中间帧。

更近期的方法使用神经网络,端到端地联合估计运动并合成中间帧,从而在快速相机平移或物体遮挡等复杂运动上产生更清晰的结果。

输出结果:24 帧每秒的素材通过合成的中间帧以 60 帧每秒播放,显著减少了感知上的卡顿感。

基于光流的插值在可预测的运动上表现良好,但在非常快速的运动、运动模糊或场景切换时可能会产生伪影。大多数工具会检测场景切换,并在过渡处跳过插值。

放大:“4 倍”的实际含义

传统的 4 倍放大通过已知像素之间的插值,将 480p 帧转换为 1920×1080 帧。输出具有正确的尺寸

免责声明:本文内容来自互联网,该文观点不代表本站观点。本站仅提供信息存储空间服务,不拥有所有权,不承担相关法律责任。如发现本站有涉嫌抄袭侵权/违法违规的内容,请到页面底部单击反馈,一经查实,本站将立刻删除。